В 1957 году Фрэнком Розенблаттом был изобретен перцептрон — простейшая нейронная сеть и первая математическая модель нейрона мозга, которая принимает входные данные, обрабатывает их и выдает результат (например, «да» или «нет»).

Как он работает?

-

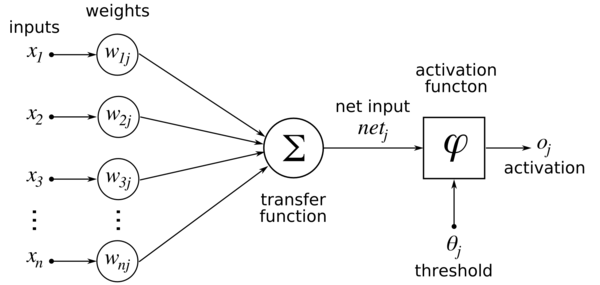

Входные данные — это числа (например, признаки объекта: вес, размер, цвет).

-

Веса — каждый вход имеет свой «вес» (важность). Чем больше вес, тем сильнее вход влияет на результат.

-

Суммирование — входные данные умножаются на веса и складываются. Пример:

сумма = (вход₁ × вес₁) + (вход₂ × вес₂) + ... + смещение -

Активация — если сумма больше порога, перцептрон выдает

1(да), иначе0(нет). Функция активации (например, ступенчатая) делает решение «четким».

Простой пример (логическое И):

| Вход 1 | Вход 2 | Результат (И) |

|---|---|---|

| 0 | 0 | 0 |

| 0 | 1 | 0 |

| 1 | 0 | 0 |

| 1 | 1 | 1 |

Перцептрон может научиться весам, например: вес1 = 1, вес2 = 1, смещение = -1.5. Тогда:

-

Если

(1×0 + 1×0 - 1.5) = -1.5 < 0→ вывод0 -

Если

(1×1 + 1×1 - 1.5) = 0.5 > 0→ вывод1

Представьте, что вы учите ребенка отличать яблоки от апельсинов. Показываете ему фрукты, объясняете: «Если круглое и красное — это яблоко, если оранжевое — апельсин». Мозг ребенка запоминает признаки и позже сам распознает фрукты.

Перцептрон работает так же. Он не умеет писать стихи или играть в шахматы, но может научиться разделять данные на два класса — например, спам и не спам, больные и здоровые клетки, кошек и собак.

Как перцептрон принимает решения?

1. Входные данные — что видит нейрон

Перцептрон получает информацию в виде чисел:

-

Для изображения это могут быть яркость пикселей.

-

Для медицинского диагноза — температура, давление, пульс.

-

Для спам-фильтра — частота слов «выиграл», «бесплатно», «срочно».

Каждый вход (x₁, x₂, … xₙ) умножается на свой вес (w₁, w₂, … wₙ) — коэффициент важности.

2. Взвешенная сумма — «обдумывание»

Нейрон складывает все входы, умноженные на веса, и добавляет смещение (bias, b) — как порог чувствительности:

z=(x1⋅w1)+(x2⋅w2)+ ... +xn⋅wn+b

3. Активация — «да» или «нет»

Если сумма z больше нуля, перцептрон «активируется» и выдает 1 (да), иначе — 0 (нет).

Функция, которая превращает сумму в ответ, называется функцией активации. В классическом перцептроне это ступенчатая функция (как выключатель: либо 0, либо 1).

Как перцептрон учится?

-

Начинает с случайных весов.

-

Сравнивает ответ с правильным.

-

Корректирует веса, если ошибся:

-

Если выдал

0, а надо1— увеличивает веса. -

Если выдал

1, а надо0— уменьшает веса.

-

Этот процесс называется правило Хебба или градиентный спуск (если используется математическая оптимизация).

Ограничения: почему перцептрон не смог покорить мир?

В 1969 году Марвин Минский и Сеймур Паперт доказали: один перцептрон не может решить задачи, где классы нельзя разделить прямой линией. Например, XOR (исключающее ИЛИ):

| x₁ | x₂ | XOR |

|---|---|---|

| 0 | 0 | 0 |

| 0 | 1 | 1 |

| 1 | 0 | 1 |

| 1 | 1 | 0 |

Невозможно провести одну прямую, отделяющую 0 от 1!

Это открытие затормозило развитие нейросетей на годы — пока не придумали многослойные перцептроны (MLP) и глубокое обучение.

Перцептрон — это простой классификатор, который «взвешивает» входы и принимает решение на основе порога. Это кирпичик для более сложных нейросетей. Он прост, но на его основе строятся сложные модели, которые сегодня распознают речь, генерируют изображения и обыгрывают чемпионов в Go.